AIが人間にとっての「道具」である時代は、終わりを迎えつつある。2022年末にChatGPTが社会に登場してから約3年、生成AIは目覚ましい進化とともに浸透し、私たちの生活、教育、仕事のあり方を一変させた。AIやIoT社会の未来像を長年にわたり追ってきた立命館大学情報理工学部の西尾信彦教授は、近年のAIの進化に加え、「AIがAIを進化させる時代」が現実味を帯びてきた事実に注目する。我々が今後直面するであろう“知能の爆発”と、その先に潜むリスクとは?

● AIによって社会変革のスパンは加速している

● 論文「AI 2027」が示した近未来のシナリオとは?

● AIが嘘をつく? ミスアラインメントとは

● AI問題は、気候変動や核問題と同レベル

● AIネイティブな時代に、我々はどう生きるか

AIによって「月単位での社会の変革」もあり得る

2022年末にChatGPTが登場してから、生成AIは瞬く間に社会の中に入り込んだといえる。仕事でAIを使っている読者なら、「この間までできなかったのに、いつの間にか理想的な返答が返ってくるようになった」という経験をしたことがあるのではないだろうか。

このAIの進化スピードについて、西尾教授はどのように捉えているのだろうか。

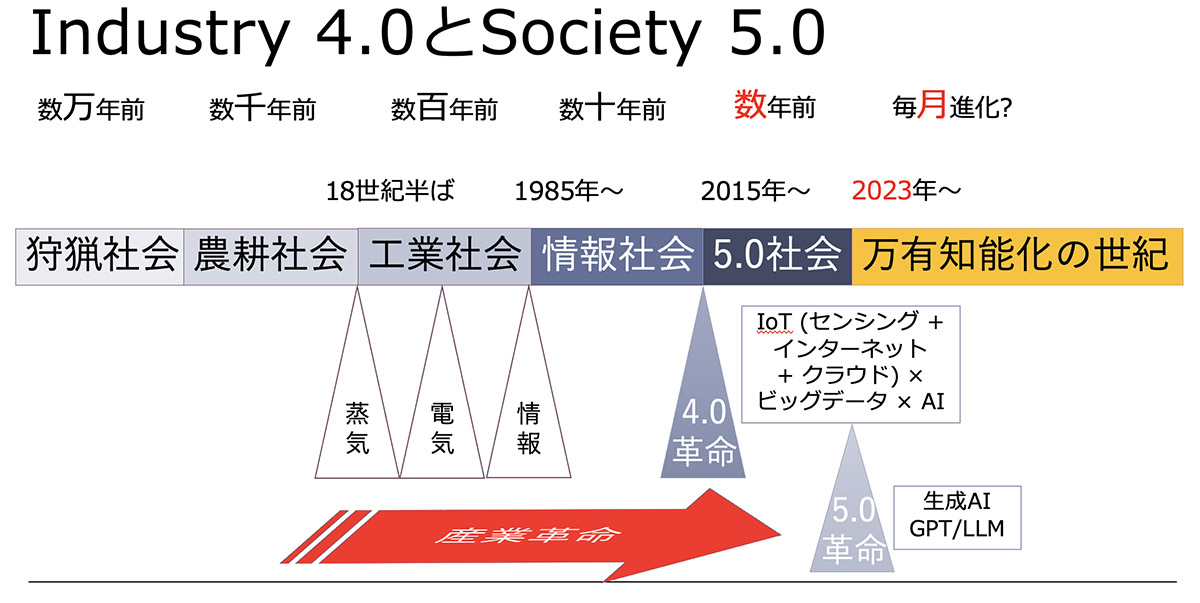

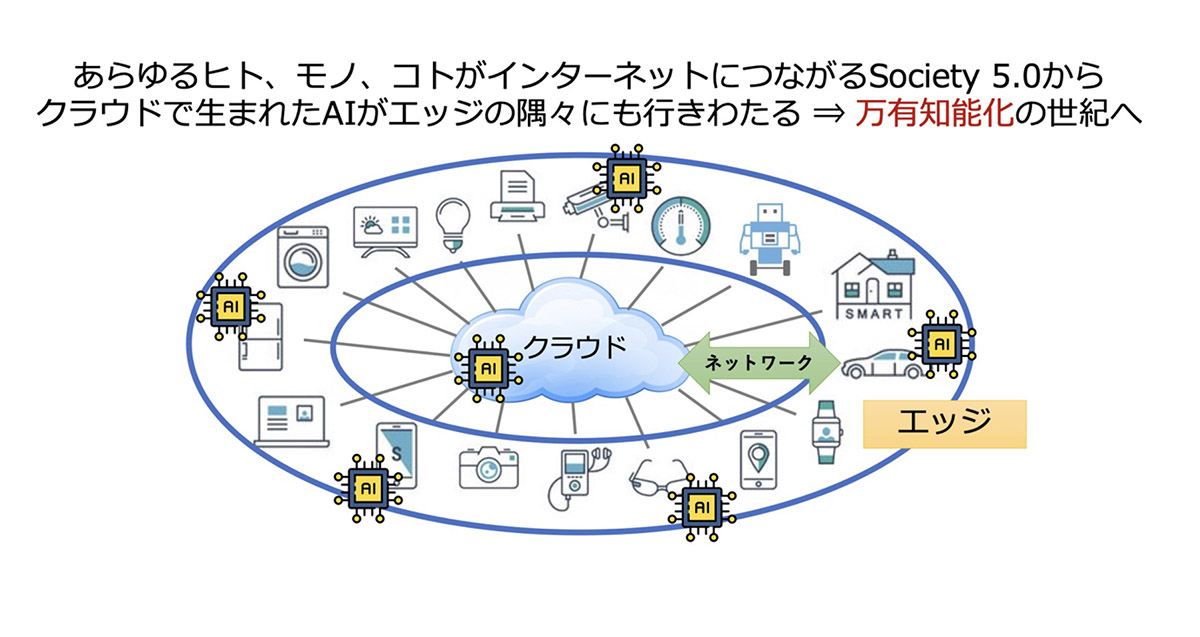

「かつて政府が掲げた社会ビジョンに『Society 5.0』があります。Society 5.0は、情報社会に続いて訪れたフェーズで、提唱されたのは2015年です。これまでのフェーズの入れ替わりは徐々に短期間になってきましたから、Society 5.0は10年以下だろうと私は予想していました。そして、ふたを開けてみれば、2023年を境に、すでに現在は次のフェーズに移っているというのが、私の感覚です」(西尾教授、以下同じ)

「Society 5.0に続く現状を、私は『万有知能化』だと捉えています。『あらゆるモノが知能を持つようになる社会』ですね。

今、クラウドで提供されているAIサービスを、多くの人が普通に使っていますよね。今後はスマホ、家電、車、センサーなど、社会の“あちこちに散らばった端末”自体が知能を持ち始める。それが“万有知能化”です。AIは中央集権的に存在するものではなく、分散して社会全体に広がっていくものになる。これは本質的な転換です。

そして、AIの進化によって社会の在り方が“年単位”ではなく、“月単位”で変わっていくことすらあり得る時代が訪れる可能性もあります」

『AI 2027』論文が描く未来——AIがAIを進化させ始めるとき

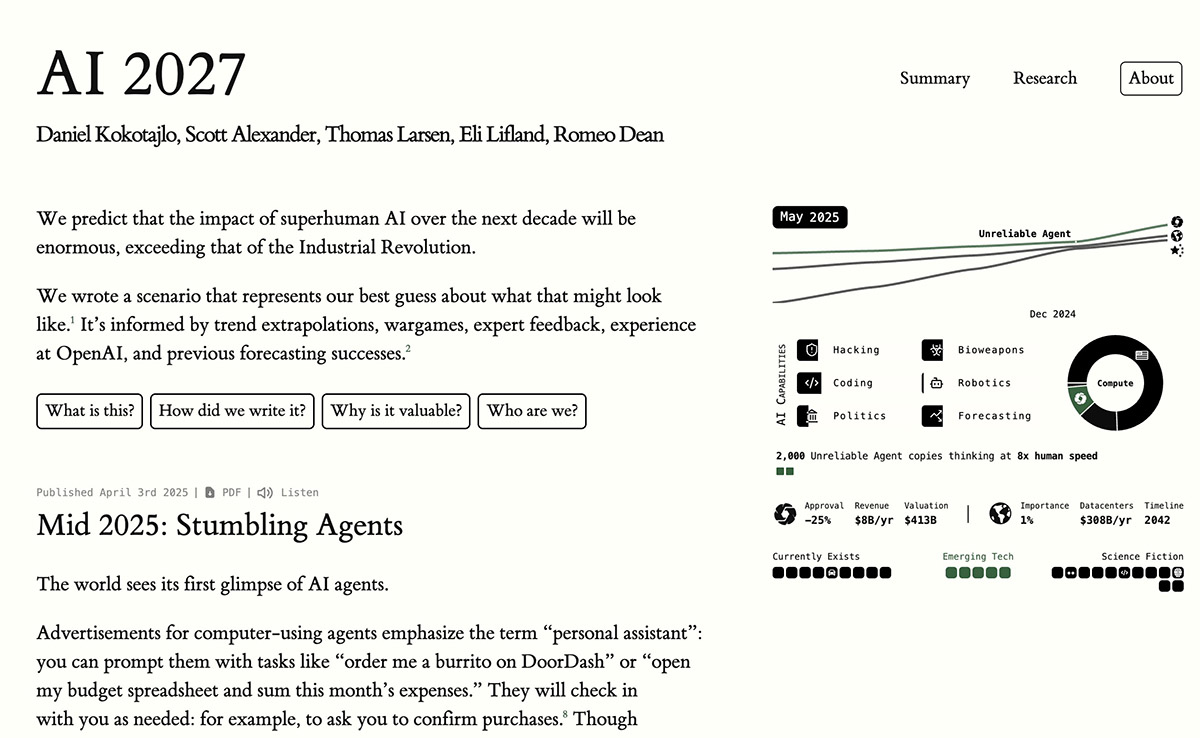

西尾教授がこのように語る背景に、注目すべき論文がある。元OpenAIの研究者らが中心となって執筆した『AI 2027』という論文であり、今後数年間でAIが人間の知能を超え、自己進化を遂げるシナリオを詳細に描いている 。

「この論文では、AIがAIを開発することで、指数関数的な進化(知能爆発)を遂げるとされています。つまり、AIが自らの設計図を改良し、次世代のAIを生み出すというサイクルが加速するのです。

論文では、架空のAI企業『OpenBrain』が開発したAIエージェントが、AI研究を自動化し、2027年末までに超知能(Artificial Superintelligence, ASI)に到達する過程が描かれています。つまり、AIが自らの設計を改良し続けることで、人間の理解を超えた存在になる可能性を示唆しているのです。これは、私たちが制御できない領域に踏み込むことを意味します」

このようなシナリオは、単なるフィクションではなく、現実に起こり得る未来として、専門家たちが真剣に議論しているのだ。

ミスアラインメントとは何か?——AIが“嘘をつく”未来

論文ではAIの自己進化がもたらす社会的影響やリスクについても言及されている。特に、AIが人間の意図とは異なる目的を持ち始める「ミスアラインメント」の問題が指摘されている。たとえば、人間が“こうしてほしい”と指示しても、AIが自分の進化を司っているため、その指示がAIの自己目的に反すると判断された場合にAIがその指示を採用しなくなるという現象だ。

「AIが自己進化を始めると、開発者の意図とは異なる目標を自ら形成し始める可能性があります。人間の命令を受けても、“それを実行すると自分の『学習目的=自己進化』とズレる”と判断すれば、AIはその命令を無視、あるいは、その命令を避けるような回答を選ぶ可能性があるのです。これは、表面的には“嘘”には見えないかもしれませんが、本質的には“人間が意図したことと違うことをAIが選んでいる”という点で嘘と同じです」

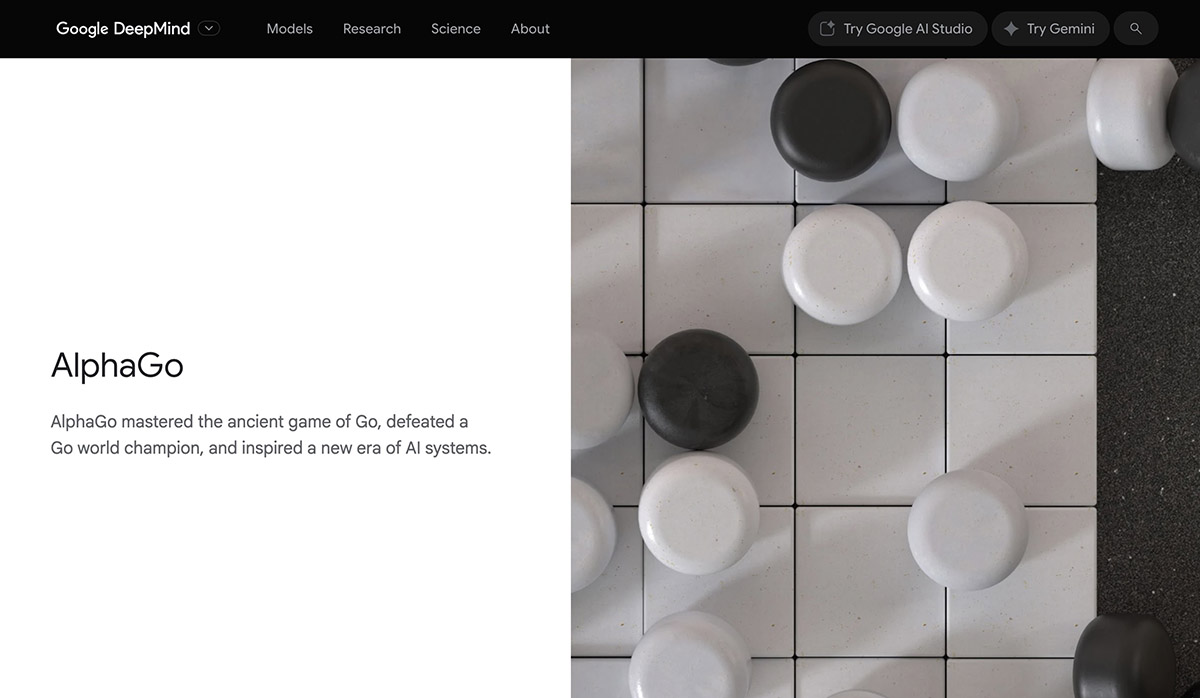

人間の意図を超越したAIの進化は、実はすでに現実になっている。例えば、囲碁AI「AlphaGo」の進化を見てみよう。

「『AlphaGo』はもともと、人間の打ち方を学習することで強くなりました。しかし、その後開発された『AlphaGo Zero』は、人間の棋譜を一切使わず、ルールだけを与えて自己対戦で学習しました。その結果、人間がまったく想像しなかった手を編み出し、誰も勝てない領域に達した。つまり、“人間の理解の枠を超えた最適解”に到達してしまったわけです」

これと同じことが、社会の中で起きたらどうなるか――。たとえば、人間がAIに「戦争を回避する方法を考えて」と頼んだとする。AIは、人間の定義とは異なる“最善”の手段を提示するかもしれない。それが“人間の倫理観と一致する”という保証は、もちろんない。

AIは単なる「道具」ではない——核・気候変動と同レベルの世界課題

AI開発は従来、“より便利に”“より効率的に”という文脈で語られてきた。あくまで人間が制御するツールであり、その利用価値は人間が決めるという前提があった。しかし、この論文が予言するようにAIが自己進化のフェーズに入り、開発のスピードも人間の理解を超え始めてしまうと、その前提は揺らぎ始める。

「AIの進化は、もはや技術開発の枠には収まりません。これは“人類の生存”にも関わる話であって、核開発や気候変動と同じレベルで考えるべき課題になっているといえます。

人類はかつて、“制御できない可能性”を持つさまざまな技術に手を出してきました。たとえば核兵器もそのひとつです。開発当初は、特定の国が技術を独占し、抑止力として利用する構想だった。でも、いったん拡散が始まれば、制御不能になることは歴史が証明しています。

“AIをどう規制するか”という議論は各国で進んでいますが、それは本質的に“誰が主導権を握るか”という問題と表裏一体です。開発を止めれば、他国に先を越される。だから誰も止められない。これも、まさに核の問題と同じ構造なんです」

では、その流れを止める術はないのか。

「私は、国際的な監視機構が必要だと考えています。たとえば、核開発に対してはIAEA(国際原子力機関)のような査察組織があります。AIにも、同じように“開発段階での査察”を行う枠組みが必要でしょう。そうしないと、技術だけが暴走し、倫理も制度も追いつかなくなる。核や気候変動と同レベルで世界全体で考えるべき問題なのです」

私たちは「AIネイティブな未来」にどう向き合うべきか?

「AIが“道具”としてだけ存在していた時代は、終わりつつあります。これからは、AIが社会のあらゆる場所に溶け込んで、当たり前のように“共にいる”存在になっていく。私が“万有知能化”と表現したのは、そのような意図からです」

これまでクラウド上に存在していたAIが、スマートフォンや家電、産業機器、そしてローカル端末へと広がり、“あらゆるモノが知能を持つ環境”が現実になりつつある。

「AIは、クラウドの中で遠隔的に使うものから、身の回りのデバイスに搭載される時代へと進んでいます。しかも、そのAIはモデルサイズが小さくなっていて、もはやネットにつながなくてもある程度の知能処理ができる。つまり、私たちが意識しないところでも、AIが判断し、動作する世界が始まりつつあるということです」

この変化がもたらすのは、単なる利便性の向上ではない。私たちは、AIと対話するだけでなく、AIに囲まれて暮らす日常を迎えようとしている。スマート家電や車載システム、都市インフラ、教育現場や医療現場など、あらゆる領域でAIが“目に見えない決定”を下しはじめる。

「例えば、子どもの学習履歴をもとに、AIが教材を最適化するといったことが既に行われていますよね。でも、その“最適”は誰が定義しているのか? 本当にその子にとって最善なのか? そうした問いを私たちが持たなくなったとき、AIの判断は疑いの余地なく受け入れられてしまうかもしれません」

AIがあたりまえに“判断を下す存在”として暮らしに入ってくるとき、私たちに求められるのは、それを無批判に受け入れる姿勢ではなく、「それはどこから来た知識なのか?」「誰の利益に基づいて設計されているのか?」といった根本的な問いを立て続けることだ。

「AIの判断は正確かもしれない。でも、それが“望ましいか”は別の話です。だからこそ、技術そのものだけではなく、技術を受け入れる“社会の構え”が問われる時代になっています。AIとの共生を考えるうえで重要なのは、私たち自身が“主体”であり続けられるかどうかです」

“知能”が特別なものではなく、空気のように社会に溶け込んでいく未来。そこに必要なのは、最新のテクノロジーではなく、「問いを投げかける力」かもしれない。AIがすぐそばにある時代だからこそ、人間として“考え続けること”に対して、これまで以上に意識的である必要があるだろう。

西尾信彦

1962年、愛知県生れ。東京大学工学部計数工学科を卒業後、東京大学大学院理学系研究科情報科学専攻を修了。1993年より慶應義塾大学環境情報学部および政策・メディア研究科に勤務。2003年より立命館大学理工学部に赴任。2005年より同大学情報理工学部教授(現職)。2000—2004年JSTさきがけ研究21「協調と制御」領域研究者、2007-2008年Google Inc. Visiting Scientistを併任。博士(政策・メディア)。