AIの急速な進化に対して、「法律はどうなっているのか」「なぜもっと厳しく規制しないのか」と感じたことがある人も多いだろう。ディープフェイクや誹謗中傷、誤情報の拡散といった問題が現実化する中で、法整備の遅れは不安を呼んでいる。しかし、AIをめぐる法律づくりは、単純に「禁止する」「罰則を強める」だけでは解決できない難しさを抱えている。日本は今、どのような考え方でAIと向き合おうとしているのか。立命館大学法学部の山田希教授に、「ソフトロー」という視点から、AI時代の法の現在地と今後の方向性を解説してもらった。

● 進化が速く用途が広いAIは一律に規制しにくい

● 責任や違法性の判断がまだ曖昧なまま

● 日本は厳格な規制ではなく「ソフトロー」を軸に対応

● 試行と改善を重ねるアジャイルなルール作りとは?

● 人格権侵害には強い法規制も必要

なぜAIの法整備は難しいのか──「追いつかない」には理由がある

AIをめぐるトラブルが相次ぐ中で、「なぜ法律で厳しく取り締まれないのか」「なぜ新しい法律がすぐに作れないのか」という疑問を抱く人は少なくない。しかし、AIの法整備が難しい背景には、技術の問題だけでなく、法律の仕組みそのものが抱える構造的な課題がある。

「一度作った法律は、長く使われることを前提にしています。そのため、ある程度安定した社会状況や技術を想定して制度設計が行われます。一方、AI技術は数年単位、場合によっては数か月単位で姿を変えていく。ここに、どうしてもズレが生じます。

また、自動車や医薬品のように、用途が比較的限定されているものとは違い、AIは特定の分野に閉じた技術ではありません。検索、翻訳、画像生成、医療、金融、教育など、社会のあらゆる場面に横断的に入り込んでいます。この『汎用性の高さ』も、法整備を難しくしている要因といえます。一律のルールを作ろうとすると、どこかで過剰規制になったり、逆に不十分になったりしてしまうのです」(山田教授、以下同じ)

さらに、AIには「使い方次第で善にも悪にもなる」という側面がある。便利なツールであると同時に、悪用されれば深刻な被害を生む。この二面性が、単純な禁止や規制を難しくしている。

「AIそのものが悪いわけではありません。問題は、どう使われるかです。だからこそ、『AIを禁止する』という発想だけではなく、どう使われたときに、誰がどのような責任を負うのかを慎重に考える必要があります」

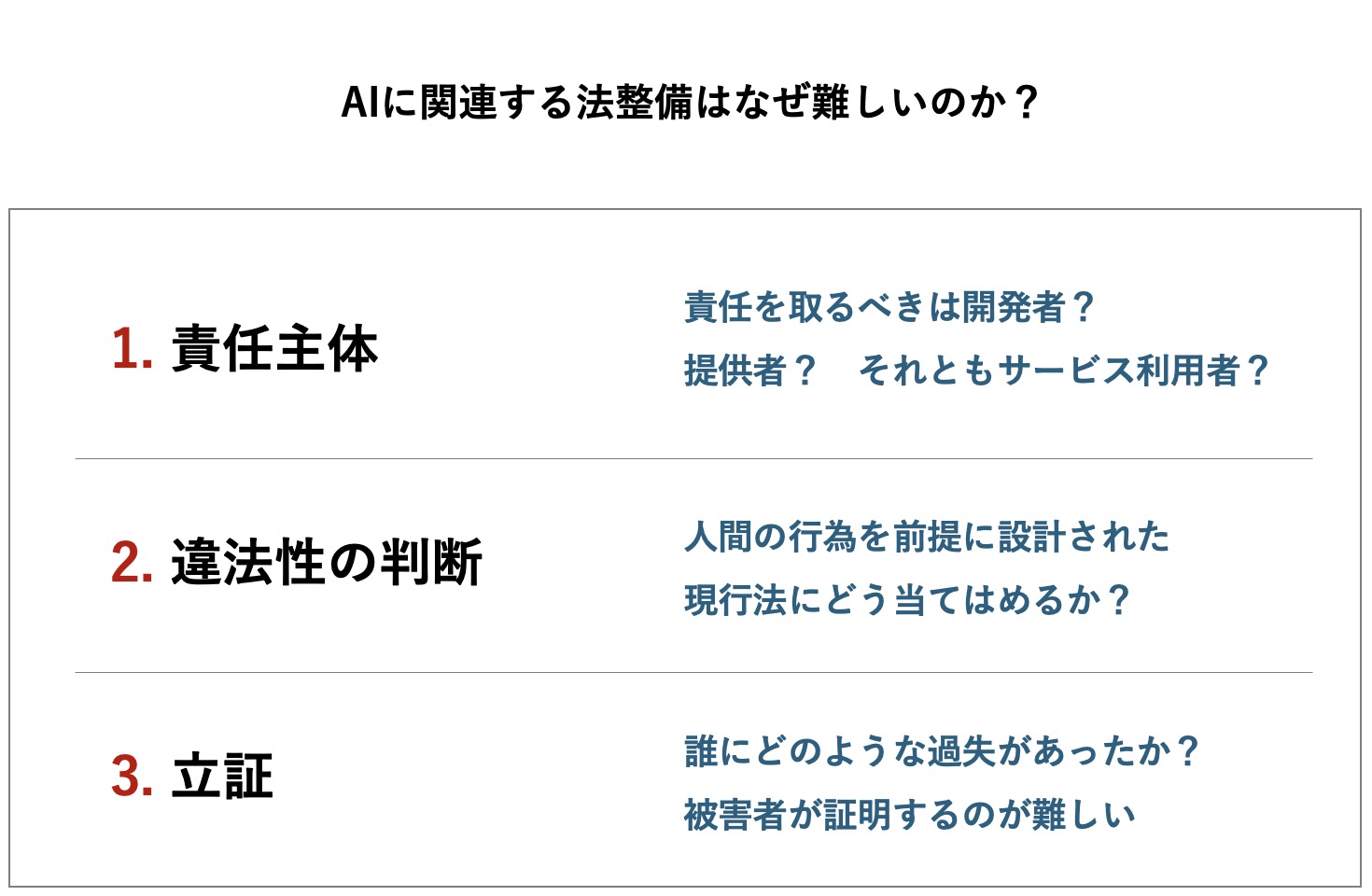

何が決まっていないのか──責任・違法性・立証の曖昧さ

AIをめぐる法整備の難しさは、「追いついていない」という一言では片づけられない。実際には、AIによるトラブルが起きたとき、誰に、どのような責任があるのかを判断する基準そのものが定まっていないという問題がある。

「まず大きいのは、責任主体の問題です。AIを使って問題が起きた場合、開発者なのか、提供者なのか、それとも利用者なのか。どこまで責任を負うべきかについて、明確なルールはまだありません。

たとえば、生成AIが誤情報を出力し、それが拡散された場合、『誰が加害者なのか』を一意に定めるのは簡単ではありません。AIは単独で動いているわけではなく、複数の主体が関わる中で使われていることが多いからです。

また、違法性の判断も簡単ではありません。従来の法律は、人間の行為を前提に設計されていますから、AIが関与した行為を既存の法概念にどう当てはめるかが、必ずしも明確ではないのです。名誉毀損やプライバシー侵害といった既存の法律が適用される場面もありますが、AIが介在することで、故意や過失をどう評価するのかが分かりにくくなります。どの時点で、どの行為が違法なのか、その線引きは非常に難しいといえます」

もう一つ大きな壁になるのが、「立証」の問題だ。裁判で責任を問うためには、被害が起きた事実だけでなく、誰にどのような過失があったのかを示さなければならない。しかし、AIの内部構造や学習過程はブラックボックス化していることが多く、被害者側がそれを証明するのは容易ではない。

「AIがなぜその判断をしたのか、なぜそのアウトプットが生まれたかを、外部から完全に説明することは極めて難しいんです。結果として、被害者が立証責任を果たせず、救済にたどり着けない状況も生まれています」

日本の現在地──AI新法と「ソフトロー(Soft Law)」を軸としたアプローチ

AIをめぐる課題が顕在化する中で、日本ではどのような形で法整備が進められているのだろうか。山田希教授は、日本のAI政策の特徴を「いきなり強い規制をかけない点」にあると解説する。

「日本では、AIを一律に規制する包括的な法律をすぐに作る、という方向はとられていません。まずはガイドラインや指針といった形で、望ましい行動の方向性を示し、現場の動きを見ながら調整していく、いわゆる『ソフトロー(Soft Law)』という考え方が中心です」

ソフトローとは、法律のように違反すれば直ちに罰則が科されるものではないが、行政や関係機関が示す指針を通じて、社会全体の行動を誘導する役割を担う。

「AIは技術の変化が非常に速い分野です。将来の動向がわからないまま厳格な法律を作ってしまうと、すぐに時代遅れになったり、将来の有益な活用を縛ってしまったりするおそれがあります。だからこそ、まずは柔軟に対応できるルールで様子を見る、という方針がとられているのです。

日本では総務省や経済産業省が中心となり、AI事業者向けのガイドラインが整備されてきました。そこでは、人権の尊重や透明性の確保といった原則が示されていますが、強制力は持っていません。

ソフトローのメリットは、現場の創意工夫を残せる点にあります。AIは、医療、金融、教育など、使われる分野によってリスクの性質がまったく異なるので、細かく一律のルールを決めるよりも、各分野で適切な対応を考えてもらう余地を残す方が、利活用を促進できる場合も多いのです」

一方、もちろんそこにはデメリットもある。

「ガイドラインは、守られなかった場合でも、すぐに法的責任を問えるわけではありません。被害が起きたときに、誰がどこまで責任を負うのか、被害者をどう救済するのかという点では、どうしても弱さが残ります」

日本のAI法制は今、柔軟さを重視したソフトローを軸に進められている。しかし、それは「何もしない」という意味ではない。どこまでを緩やかなルールで対応し、どこからを強い制度で支えるのか。その見極めが、次の段階として問われている。

現場から見えた法整備のヒント 「アジャイル・ガバナンス」と補償モデル

では、こうした難題に対して、現場ではどのような工夫が試みられているのか。その一例が、山田教授が関わったNEDO(新エネルギー・産業技術総合開発機構)のプロジェクトだ。ここでは、AIやロボットの社会実装を進めながら、同時にルールづくりを行うという実験的な取り組みが行われた。

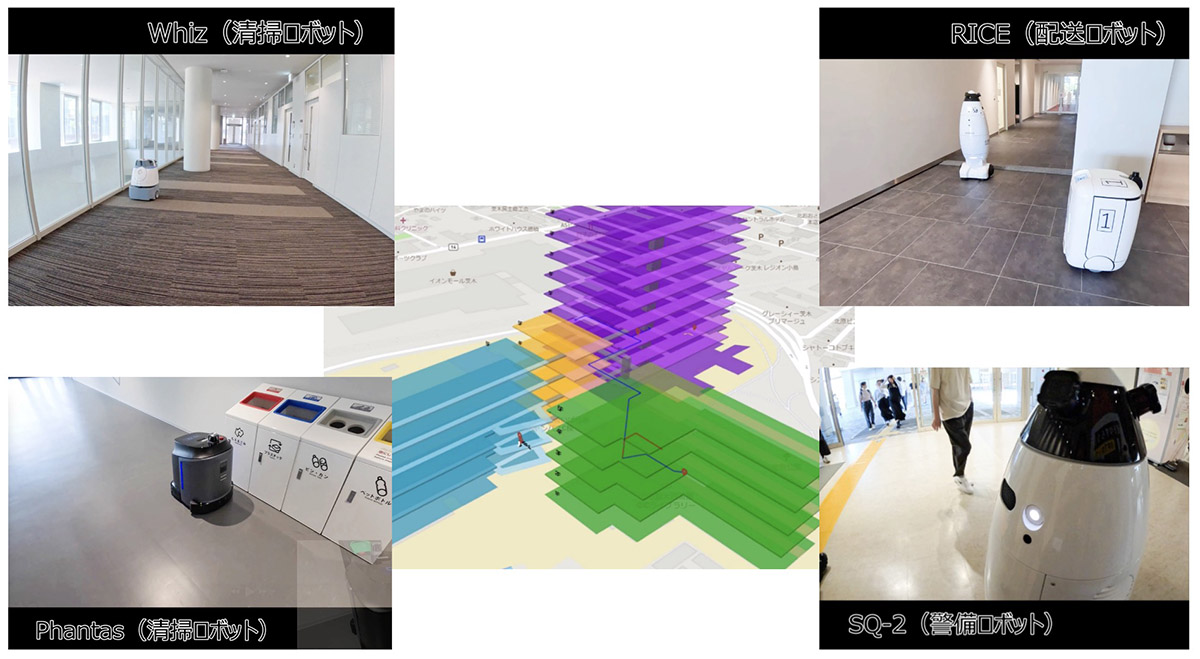

「このプロジェクトでは、立命館大学・大阪いばらきキャンパスを実証の場とし、ロボットを実際に運用する中で、安全性や信頼性を検証していきました。

ポイントは、あらかじめ完璧なルールを作るのではなく、まず実際にAIや自律移動ロボットを使ってみて、問題が起きたら原因を分析し、その結果をもとにルールを更新していく『アジャイル・ガバナンス』という手法を採用したことです。AIは、机上で想定していたリスクと、実際に使ってみて初めて分かるリスクが異なることが多い。だからこそ、運用しながら検証し、改善を重ねていく仕組みが必要だと考えました」

「また、もう一つのポイントは『補償モデル』を組み込んだ点にあります。これは、事故やトラブルが発生した際に、まず被害者を迅速に救済する仕組みです。

ここで重要なのは、補償と損害賠償を分けて考えることです。補償は、過失や法的責任の有無にかかわらず、まず被害を受けた人を救済する。その後で、原因を究明し、過失があれば求償や制裁を検討します」

この二段階の考え方には、社会的な意味もある。

「もし開発段階で起きた事故について、いきなり重い法的責任を問うと、開発者は萎縮してしまいます。そうなると、データが隠されたり、原因究明が遅れたりするおそれもある。補償モデルは、被害者救済とイノベーションの継続を両立させるための仕組みです」

アジャイル・ガバナンスと補償モデルは、AI時代の法制度を考える上での一つのヒントを示している。完璧なルールを先に作るのではなく、現実に即して調整を重ねていく。その柔軟な考え方が、急速に進化するAIと向き合いながら法整備をする上で重要な示唆となった。

人格権侵害には“強い法規制(ハードロー)”も必要になる

ソフトローの利点は、AIの進化に合わせて柔軟に運用できることにある。分野ごとの事情を踏まえ、現場の判断を生かせる点は大きなメリットになるだろう。課題は、自主的な取り組みに頼るため、実効性に限界があることだ。特に被害が発生した際の救済や責任の明確化は、ソフトローだけでは難しい。

こうした強みと弱みを踏まえたうえで、山田教授は「ソフトローか、ハードローか」という二者択一の議論そのものに慎重な姿勢を示す。

「重要なのは、どちらか一方を選ぶことではありません。技術の発展段階やリスクの性質に応じて、使い分けることだと考えています」

そして、例外的に「強い法規制」が必要になる領域として、人格権侵害を挙げる。

「人の尊厳や人格を深く傷つけるような行為については、ソフトローだけでは対応しきれないと考えています。ディープフェイクによる性的画像や映像の生成、深刻な名誉侵害などは、一度起きてしまうと、被害を完全に回復することが極めて難しいからです。

たとえば、本人の同意なく作られた性的なディープフェイクがインターネット上に拡散された場合、その画像や動画をすべて回収することは現実的にほぼ不可能です。削除しても、どこかにコピーが残り続ける。被害者は長期間にわたって精神的苦痛を受け、社会的評価や人間関係にも深刻な影響を受けかねません。これは、お金で補償すれば済む問題ではありません。

人格権侵害の特徴は、『やり直しがきかない』点にあります。財産的な被害であれば、損害賠償によって一定の回復が図れる場合もありますが、人格や尊厳が傷つけられた場合、その影響は被害者の人生全体に及ぶことがあります。だからこそ、事後的な救済だけでなく、そもそも起こさせないための強い抑止が必要になります。

その意味で、こうした領域については、明確な禁止規定や責任の所在を定めるハードローが必要になる場面があると考えています。すべてを厳しく規制すべきだということではありませんが、少なくとも人格権を重大に侵害する行為については、『やってはいけないこと』として明確に線を引くことが、社会全体として求められているのではないでしょうか」

AIとどう向き合うかは、単なる技術の問題ではない。社会として、何を守り、どこまで許容するのかという価値判断が問われている。

山田希

立命館大学法学部教授。専門は民法。科学技術の発展がもたらすリスクに対して、民法の基本的な枠組みがどのように応答しうるかを、フランス法との比較を軸に研究している。近年はAIやディープフェイクによる人格権侵害の問題にも取り組む。NEDOプロジェクトでは、AI・ロボットの社会実装におけるアジャイル・ガバナンスと補償モデルの構築にも携わる。