AIは、もはや一部の専門家や企業だけの技術ではない。生成AIの普及によって、私たちの情報環境や仕事、日常生活は急速に変わりつつある。その一方で、AIによるフェイクニュースや誹謗中傷、ディープフェイク詐欺といった新たなリスクに、法律や制度は十分に対応できていないのが現状だ。立命館大学法学部の山田希教授は、人格権の観点から、AI時代に私たちのすぐ身近で起きている問題と、その背景にある法の課題を読み解く。

● AIが生む3つの身近なリスク

● ディープフェイク詐欺が示す「犯罪の進化」

● なぜ日本では被害者が救われにくいのか

● 「泣き寝入り」を生む5つの問題点

● 私たちがいま持つべき視点・アドバイス

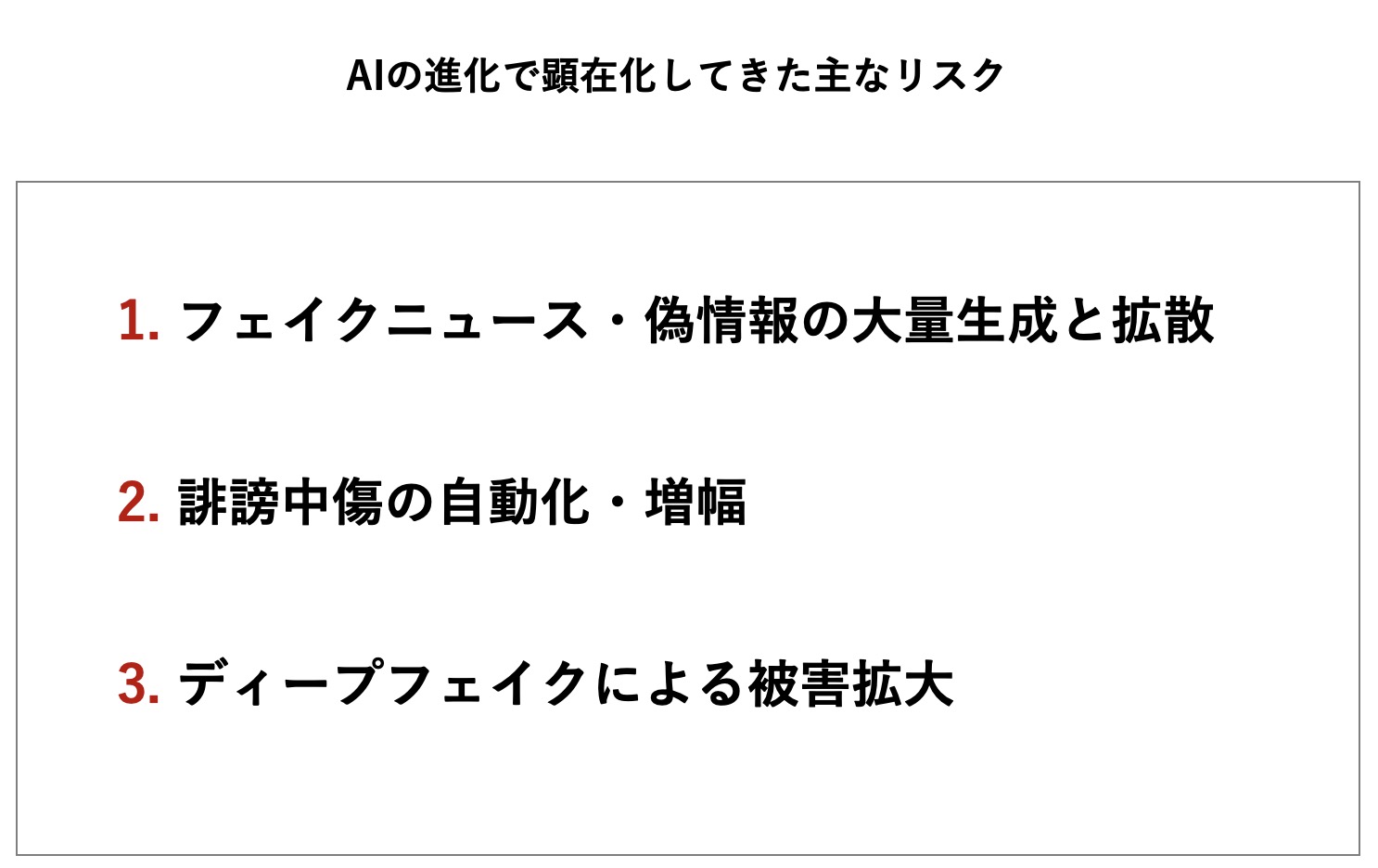

AIの進化で何が起きているのか? 私たちの身近にある3つのリスク

生成AIの普及によって、文章や画像、動画を「作ること」そのもののハードルは劇的に下がった。専門的な知識や高価な機材がなくても、誰もが短時間で“それらしい情報”を生み出せる時代になっている。便利さの裏側で、私たちの情報環境は大きく変質しつつある。山田教授は、一般の生活者にとって特に影響が大きいリスク3つを挙げてくれた。

「1つ目は、フェイクニュースや偽情報が、短時間で大量に作られ、広く拡散されるようになったことです。生成AIを使えば、もっともらしい文章や画像を誰でも簡単に作ることができる。災害時に被害を誇張した偽画像が出回ったり、選挙期間中に政治家の発言を捏造した動画が拡散されたりする事例は、日本でも海外でも増えています」(山田教授、以下同じ)

2つ目のリスクは、誹謗中傷のあり方そのものが変わってしまった点だ。これまでのネット上の攻撃は、人が一つひとつ書き込む形が主流だった。しかし、AIの登場によって状況は一変した。

「AIを使えば、特定の個人を攻撃する中傷的な文章を自動で大量生成することが技術的に可能になります。一人の人間が手作業で書くのとは桁違いの量の攻撃的コンテンツが、短時間でインターネット上に溢れる。これは、従来の『炎上』とは質的に異なる脅威です」

中傷が“自動化”されることで、被害の規模やスピードは格段に増す。被害者は、理由も分からないまま大量の攻撃にさらされ、精神的に追い詰められていく。

そして3つ目が、最も深刻な問題とされるディープフェイクだ。本人の顔や声を使い、実際には存在しない映像や音声を作り出すこの技術は、悪用された場合、人の尊厳や人格権を根底から傷つけかねない。

「特に問題なのが、本人の同意なく作成される性的なディープフェイク画像や動画です。韓国ではこの被害が学校現場などで社会問題化し、2024年9月に、いわゆる『ディープフェイク性犯罪防止法』が成立しました。日本でも同様の被害は起きていますが、法整備は遅れているのが現状です。

2024年の調査では、ディープフェイクを見分けられると答えた人は2%未満でした。技術の進歩により、専門家であっても判別が困難なレベルに達しています」

AIは、私たちの生活を便利にする一方で、誤情報や人格権侵害を、これまで以上に“起こしやすく、広げやすい”環境を生み出している。その影響は、すでに私たちのすぐ身近なところまで及び始めている。

「本人確認」はもはや安全ではない──香港ディープフェイク詐欺事件

AIの高度化は、すでに現実の事件として深刻な被害を生んでいる。その象徴的な事例が2024年に香港で発生したディープフェイク詐欺事件だ。

この事件では、企業の財務担当者が、英国本社のCFO(最高財務責任者)を名乗る人物から連絡を受けた。「極秘の取引が進んでおり、至急送金が必要だ」という内容だったという。担当者は当初、詐欺を疑った。しかし、その後に行われた“ある確認”が、疑念を消し去ることになる。

「犯人は、CFOや同僚になりすましたディープフェイク映像を使い、ビデオ会議を行いました。画面に映る顔も声も、被害者が知っている本人そのものだった。複数人が参加する会議だったこともあり、『これは本物だ』と信じてしまったのです」

結果として、被害者は約2億香港ドル、日本円にしておよそ38億円もの資金を送金してしまった。事件は捜査が続けられているが、失われた信頼と被害の大きさは計り知れない。この事件が衝撃的なのは、被害者が決して無警戒だったわけではない点にある。むしろ、「怪しい」と感じ、一度は立ち止まっている。それでも、ビデオ会議で顔と声を確認したことで、安心してしまった。

「これまで私たちは、『顔を見て話せば本人確認になる』と考えてきました。しかし、この事件は、その前提がすでに崩れていることを示しています。映像や音声があるからといって、本物だとは限らない時代になったのです。

犯人は、公開されている写真や動画を素材に、あらかじめ複数の映像クリップを作成し、それを会議中に再生していたと考えられます。つまり、完全なリアルタイム生成でなくても、人を騙すには十分だったということです」

この事件が示したのは、AI犯罪の高度化だけではない。私たちが長年信じてきた「本人確認」や「目で見て確かめる」という感覚そのものが、もはや安全装置として機能しなくなっている現実だ。AIによるなりすましは、すでに企業活動や日常生活の前提を揺るがし始めている。

なぜ止められないのか──日本の法律では「責任」が見えにくい

フェイクニュースやディープフェイクによる被害が現実に起きているにもかかわらず、日本では「誰が、どのような責任を負うのか」が分かりにくい。多くの人が抱くこの疑問の背景には、AIをめぐる法制度の構造的な問題がある。

現在、日本ではAIによる被害が発生した場合でも、基本的には既存の法律を当てはめて対応している。名誉毀損やプライバシー侵害、肖像権侵害などがその代表例だ。しかし、これらの法律は、そもそもAIの存在を前提に作られたものではない。

「日本では、AIによる人格権侵害に対して、名誉毀損や肖像権侵害といった既存の法律を使って対応しています。ただ、これらはAIを想定した制度ではありません。そのため、どこまで適用できるのかが非常に分かりにくいのです。

特に問題になるのが、ディープフェイクのようなケースです。実際には存在しない画像や映像であっても、被害者の顔や身体が使われ、人格や尊厳が深く傷つけられます。しかし現行法では、その行為自体を直接取り締まる規定が乏しい。

たとえば、ディープフェイクポルノについては、2023年に施行された性的姿態等撮影処罰法がありますが、この法律は『撮影』行為を前提としています。AIで生成された画像や映像は、必ずしも対象になるとは解釈されていません。結果として、明確に処罰できないグレーゾーンが生まれているのです」

さらに難しいのが、「誰の責任を問うのか」という問題だ。AIによる被害には、開発者、提供者、利用者といった複数の関係者が関わる。だが、現行法では最終的に行為を行った「利用者」の責任を問う構造が中心になっている。

「AIの場合、どの段階で、誰の判断が問題だったのかを特定するのが非常に難しいのです。利用者だけでなく、悪用を容易にする仕組みを提供した側の責任をどう考えるのか、十分に整理されていません」

AIによる被害が拡大しているにもかかわらず、法的な責任の所在が曖昧なままであること。これが、被害の抑止や迅速な救済を難しくしている大きな要因だ。

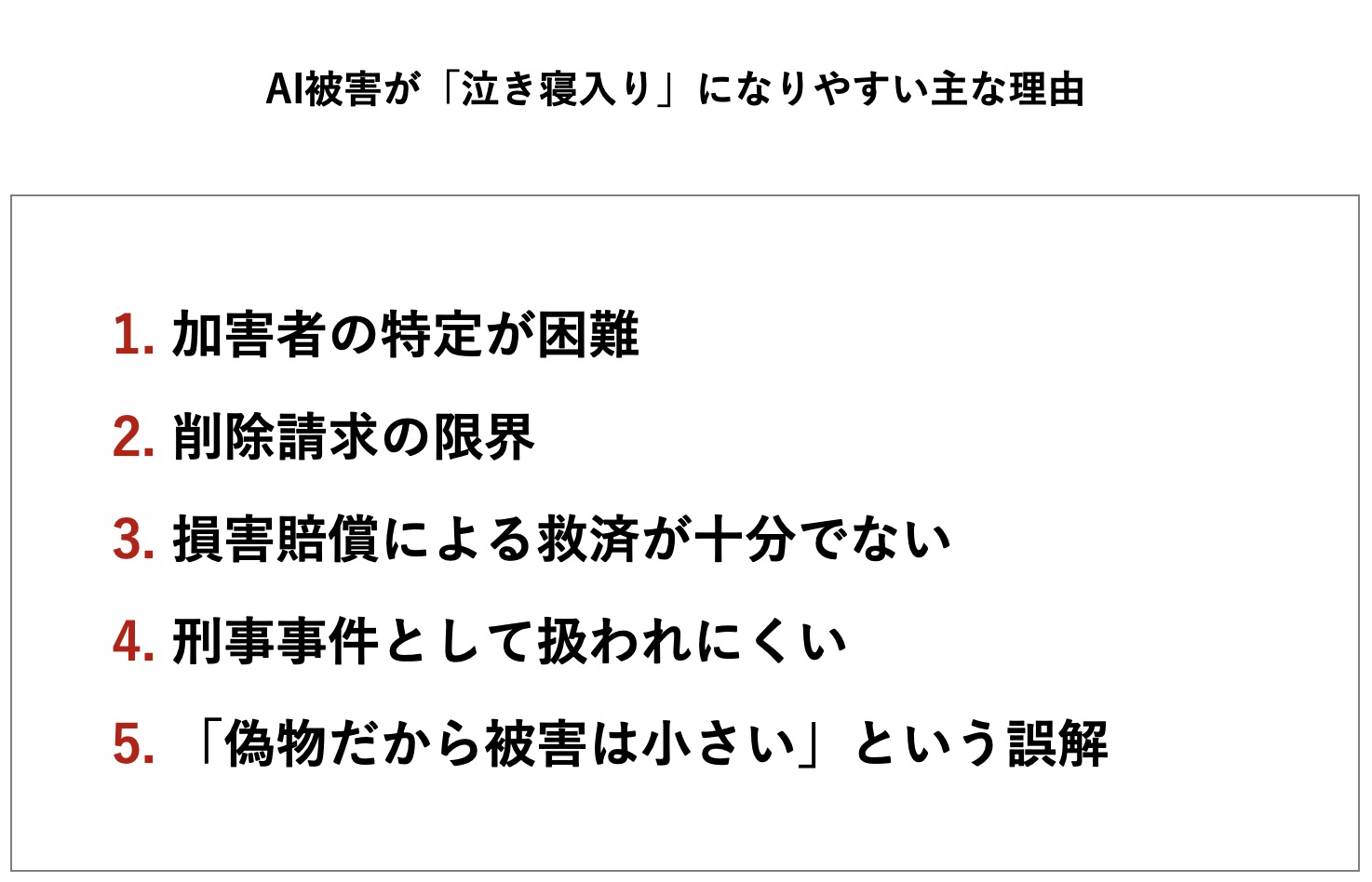

なぜ「泣き寝入り」になってしまうのか──被害者を追い込む5つの問題

ディープフェイクや誹謗中傷の被害に遭っても、多くのケースで被害者は十分な救済を受けられていない。なぜ、これほど深刻な被害が起きているにもかかわらず、「泣き寝入り」になってしまうのか。山田教授は、その背景にある構造的な問題を5つ挙げる。

●問題1:加害者の特定が困難

「インターネット上では、加害者が匿名で行動している場合が多く、まず発信者を特定する必要があります。発信者情報開示請求という制度はありますが、時間も費用もかかりますし、海外のサーバーを経由していると、さらに手続きは複雑になります」

●問題2:削除請求の限界

「仮に一つのサイトやSNSから削除できたとしても、完全に被害を止めることはできません。一度インターネット上に出た情報は、別の場所に転載され続けます。いわゆる『デジタル・タトゥー』の問題です」

●問題3:損害賠償による救済が十分でない

「名誉毀損やプライバシー侵害で裁判を起こしても、日本では賠償額が比較的低くなる傾向があります。弁護士費用や裁判にかかる時間と労力を考えると、被害者にとっては割に合わないと感じてしまうケースも少なくありません」

●問題4:刑事事件として扱われにくい

「ディープフェイクによる被害は、警察に相談しても『民事の問題』とされることがあります。名誉毀損罪として立件するには、公然性や事実の摘示といった要件を満たす必要があり、ハードルが高いのが現状です」

●問題5:「偽物だから被害は小さい」という誤解

「ディープフェイクは合成されたものであり、『実際に撮影されたわけではない』という理由で被害が軽視されがちです。しかし、被害者にとっては、自分の顔や身体が性的な文脈で使われている事実に変わりはありません。精神的苦痛は非常に大きいものです」

これら5つの問題が重なり合うことで、被害者は声を上げる前に疲弊してしまう。法的に闘う選択肢が見えにくい構造そのものが、「泣き寝入り」を生み出しているのだ。

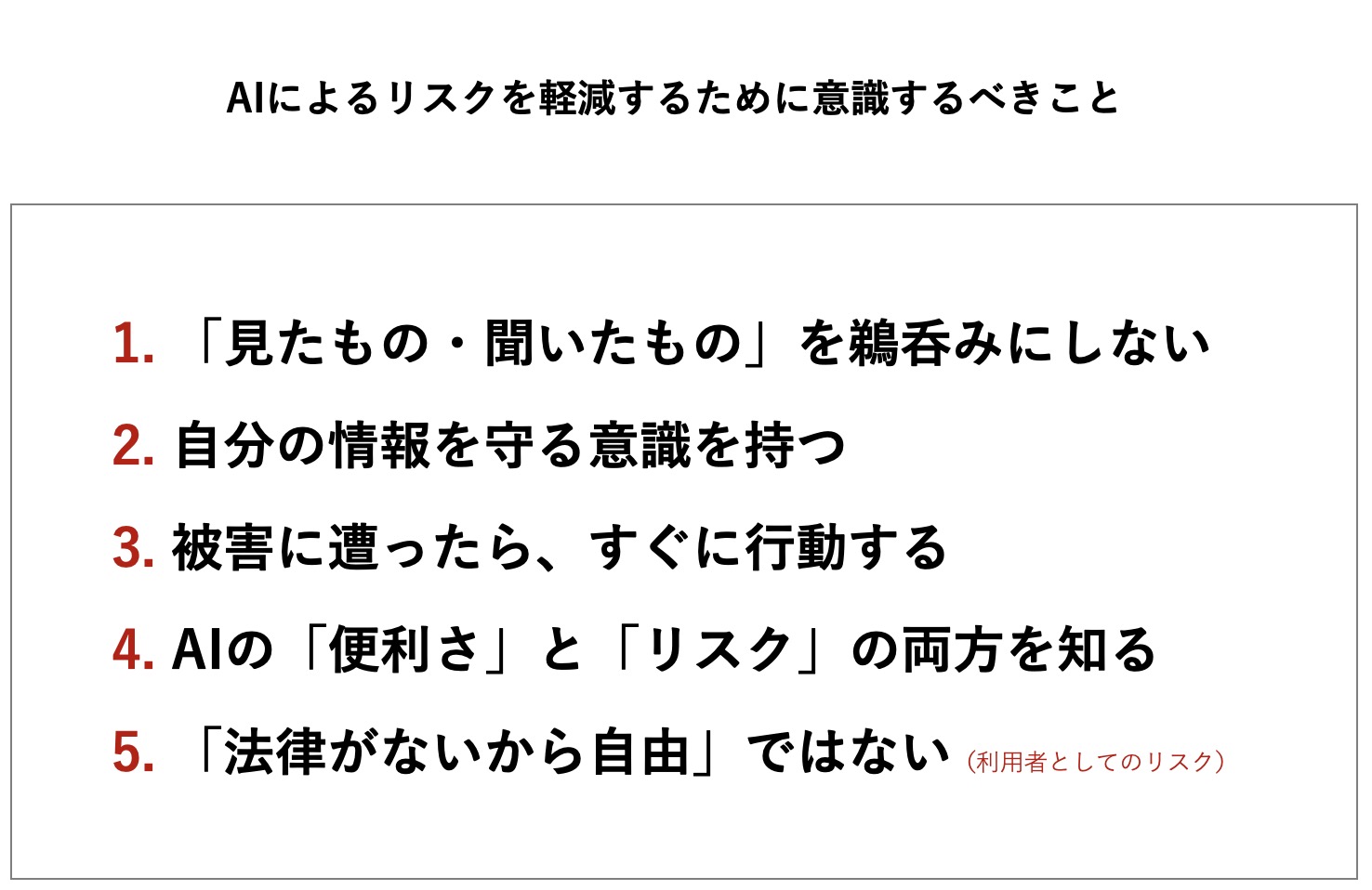

専門家が教える、一般生活者へのアドバイス

ここまで見てきたように、AIによるリスクは決して特殊な人や企業だけの問題ではない。誤情報やディープフェイク、誹謗中傷といった被害は、誰もが当事者になり得る時代に入っている。では、こうした状況の中で、私たちはどのようにAIと向き合えばよいのだろうか。法学者の立場から、山田教授は一般生活者に向けて、いくつかの具体的なアドバイスを示してくれた。

●1.「見たもの・聞いたもの」を鵜呑みにしない

「これが最も重要です。インターネット上の画像や動画、音声が『本物』である保証はどこにもありません。トレンドマイクロの調査では、ディープフェイクを見分けられると答えた人は2%未満でした。つまり、ほとんどの人は騙される可能性があるということです。

特に、感情を強く揺さぶるような衝撃的なコンテンツや、『拡散してください』と行動を促す情報には注意が必要です。発信元を確認する、複数の情報源で裏を取るといった習慣を身につけてください」

●2.自分の情報を守る意識を持つ

「SNSに投稿した写真は、ディープフェイクの材料になりえます。特に、顔がはっきり写った写真を公開する際は、そのリスクを認識しておく必要があります。

子どもの写真についても同様です。成長記録を共有したい気持ちは分かりますが、その画像が将来どのように使われる可能性があるのか、一度立ち止まって考えてみてください」

●3.被害に遭ったら、すぐに行動する

「もし自分の画像が無断で使われている、ディープフェイクを作られたといった被害に遭った場合は、すぐに証拠を保全し、専門家に相談してください。時間が経つほど拡散が進み、被害は大きくなります。現行法では救済が難しいケースもありますが、泣き寝入りせずに声を上げることが、結果として法改正や社会の意識変化につながります」

●4.AIの「便利さ」と「リスク」の両方を知る

「AIは私たちの生活を便利にしてくれる一方で、悪用されるリスクもあります。『AIは怖いから使わない』のも、『便利だから何でも信用する』のも、どちらも適切ではありません。

AIとの付き合い方を学ぶ、いわゆる『AIリテラシー』を身につけることが、これからの時代を生きる上で不可欠になってきています。EUのAI規則では、AIに関わる人にリテラシー習得を求めていますが、一般市民にとっても同様に重要だと考えています」

●5.「法律がないから自由」ではない

「現在、日本ではAIに関する明確な法規制が少ない状況ですが、『法律がないから何をしても自由』ではありません。名誉毀損、プライバシー侵害、著作権侵害などの既存の法律は適用されます。

『軽い気持ちで』『AIだから大丈夫だと思って』という言い訳は通用しません。2025年以降、AIを悪用した事件での逮捕事例も増えています。AIは道具です。便利な道具だからこそ、倫理的に、責任を持って使うという意識が大切です」

AIは、私たちの暮らしを便利にする一方で、人の人格や尊厳にまで影響を及ぼす力を持つ技術だ。重要なのは、過度に恐れることでも、無条件に信じることでもない。何が起きているのかを知り、リスクを理解したうえで使い続けることが求められている。

では、こうしたリスクとどう向き合い、社会としてどのようなルールを作っていけばよいのか。続編となる記事では、日本のAI法制の現状と、「ソフトロー」という考え方を手がかりに、その行方を探っていく。

山田希

立命館大学法学部教授。専門は民法。科学技術の発展がもたらすリスクに対して、民法の基本的な枠組みがどのように応答しうるかを、フランス法との比較を軸に研究している。近年はAIやディープフェイクによる人格権侵害の問題にも取り組む。NEDOプロジェクトでは、AI・ロボットの社会実装におけるアジャイル・ガバナンスと補償モデルの構築にも携わる。